À l’instant où nombre d’entreprises empilent des expérimentations sans cap clair, une autre voie s’impose en opposant la mesure de la valeur à la fascination technologique et en articulant l’IA générative à des services managés qui réduisent le risque autant qu’ils accélèrent la livraison. Chez un acteur comme Nexity, la stratégie s’est structurée autour des usages, avec un cadrage méthodique qui a filtré l’enthousiasme pour ne retenir que ce qui améliore l’expérience client ou l’efficacité opérationnelle. Quatorze ateliers ont réuni 80 collaborateurs, du commerce à la DSI, pour faire émerger 80 cas d’usage, et environ la moitié seulement relevait réellement de l’IA générative. Ce tri a posé d’emblée un principe de sobriété : pas d’IA sans impact démontrable ni trajectoire de ROI. Cette rigueur a ensuite conditionné la priorisation, l’architecture et la gouvernance, afin de transformer des preuves de concept en gains concrets et pérennes.

De l’usage au ROI : une feuille de route pragmatique

Le choix de partir des métiers a conduit à une sélection serrée : cinq projets à fort retour sur investissement ont été retenus en tête de liste, puis cinq autres ont suivi, avec l’ambition d’atteindre une dizaine en production d’ici fin 2025, ambition tenue selon l’entourage du programme. La règle n’a pas varié : chaque cas devait justifier sa valeur par des indicateurs clairs, qu’il s’agisse de réduction de délais, d’amélioration du taux de conversion ou d’économies sur les non‑qualités. Cette discipline a aussi dicté le tempo budgétaire, en ajustant les moyens au potentiel réel plutôt qu’au battage médiatique. Le « vendeur augmenté » illustre ce pragmatisme : une recherche immobilière en langage naturel qui marie données structurées (prix, surfaces, localisations), non structurées (descriptions, échanges) et prédictives (appétence, saisonnalité), avec une première version livrée rapidement avant une extension vers la voix.

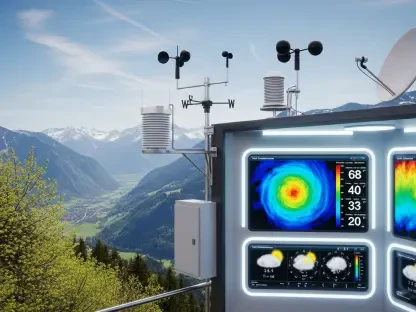

S’appuyant sur une migration opérée depuis 2019 vers un système d’information entièrement serverless, la mise en production s’est faite sans friction matérielle, en capitalisant sur des services managés pour limiter la dette technique. L’architecture a été pensée comme un jeu de briques modulaires : Amazon Bedrock pour l’accès aux modèles, AgentCore pour l’orchestration d’agents, et des services Anthropic pour compléter le panel, le tout sans personnalisation bloquante afin de préserver la réversibilité. Sur un même cas d’usage, cinq LLM ont été évalués en dix mois, preuve d’une veille active et d’un outillage permettant de changer de moteur sans réécrire l’application. Cette approche a réduit le time‑to‑market et suivi le rythme des modèles, tout en gardant la main sur la qualité : prompts versionnés, garde‑fous de sécurité, et métriques de performance intégrées dès la conception.

Prochaines étapes : cap sur l’industrialisation responsable

L’intégration d’agents dans le SI avait imposé un basculement du déterministe vers le non déterministe ; il s’était donc avéré nécessaire de renforcer la qualité des données, la sécurité by design et le contrôle des usages. Un système de badges avait réservé l’accès aux collaborateurs formés, assorti d’un référentiel de bonnes pratiques et d’un suivi des journaux d’activité. Côté processus internes, l’analyse automatisée des devis face au cahier des charges avait détecté des écarts ligne à ligne, chaque correction apportant un gain direct sur la marge. En conséquence, il avait fallu instituer des boucles de retour avec les juristes et les contrôleurs de gestion pour affiner les règles et capitaliser sur les corrections. Cette convergence entre gouvernance, métier et technologie avait sécurisé l’échelle sans freiner l’innovation.

Pour ancrer des gains durables, il avait été recommandé de poursuivre la logique de « Lego » technique en séparant nettement données, orchestrateurs et modèles, de formaliser des critères de sortie par cas d’usage (coût par requête, taux de bonne réponse, latence), puis d’étendre progressivement la voix là où elle réduisait réellement la friction. Il avait aussi été utile d’institutionnaliser des évaluations trimestrielles des LLM disponibles via Bedrock et Anthropic, d’ouvrir des bacs à sable contrôlés pour les équipes, et de renforcer l’observabilité des agents par des tableaux de bord partagés avec les métiers. Enfin, la formation avait gagné à rester ciblée : badge, parrainage, et exercices sur données réelles, afin de consolider une adoption éclairée et alignée sur la valeur. Cette trajectoire avait offert des repères concrets pour industrialiser sans renoncer à l’agilité.