Sous la pression d’expériences hétérogènes, de qubits encore fragiles et de réseaux optiques déjà saturés d’exigences, la promesse d’un Internet quantique semblait condamnée à l’îlotage technologique plutôt qu’à l’interconnexion universelle. C’est précisément ce verrou que le commutateur quantique dévoilé par Cisco prétend desserrer, en traduisant des formats de codage incompatibles sans briser l’intrication au-delà d’un seuil inférieur à 4 %. Fonctionnant à température ambiante et consommant moins d’un milliwatt, l’appareil s’insère dans la fibre standard, évitant modules cryogéniques et conversions opto‑micro‑ondes coûteuses. Cette sobriété change l’équation : elle ramène la mise en réseau quantique dans le domaine du test terrain, là où comptent les pertes cumulées, les budgets optiques, et la stabilité des sources.

L’Interopérabilité Comme Clé De Voûte

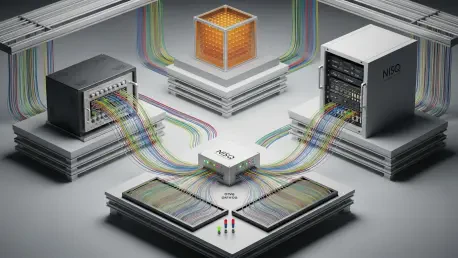

Au cœur du dispositif, un moteur de conversion orchestre la traduction entre quatre schémas majeurs : polarisation, time‑bin, frequency‑bin et codage par chemin. Chaque système quantique tend à privilégier l’un d’eux selon sa physique : photons émis par sources intégrées, memories atomiques fondées sur rubidium, ions piégés, ou circuits supraconducteurs couplés à des émetteurs optiques. En combinant ces voies, le commutateur esquisse une passerelle universelle plutôt qu’un pont ad hoc. Le pari est net : casser la dépendance à un fournisseur en reliant, par la fibre existante, un ordinateur quantique supraconducteur voisin d’un nœud photonique, lui‑même adossé à une mémoire quantique. Les essais ont fait état d’une dégradation inférieure à 4 % de la fidélité et de l’intrication, soit un niveau compatible avec des protocoles d’intrication distribuée et d’échange d’intrication sur des métrologies réalistes.

S’appuyant sur cette base, l’intégration a été pensée pour l’exploitation, non pour la vitrine : moins d’un milliwatt de consommation, pas de contraintes thermiques hors norme, et un raccordement sur des liens monomodes déployés à l’échelle métropolitaine. Cela permet aux laboratoires d’orchestrer des bancs d’essai entre campus sans recourir à des chaînes de conversion exotiques, et aux opérateurs de cartographier des itinéraires sur fibre obscure existante. Les partenariats annoncés ont jalonné une stratégie de pile complète, du matériel aux applications, avec IBM, Qunnect et Atom Computing au banc d’essai pour éprouver l’interopérabilité jusqu’au niveau logiciel. La prudence est néanmoins restée de mise : malgré quelques centaines de qubits disponibles par machine, l’agrégation réseau n’efface pas, à elle seule, les bruits, les pertes et la correction d’erreurs encore hors d’atteinte à l’échelle industrielle.

Du Prototype Aux Réseaux Pilotes : Ce Qu’il Faut Faire Maintenant

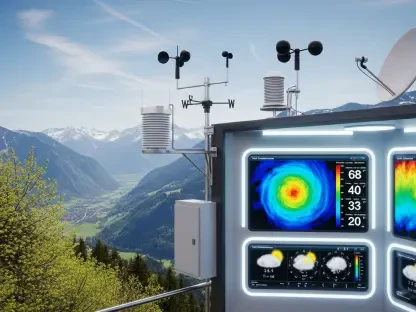

La fenêtre d’opportunité s’est dessinée autour d’une évidence opérationnelle : capitaliser sur l’infrastructure fibre pour monter des boucles métropolitaines où l’intrication circule entre plateformes hétérogènes. Concrètement, des bancs pilotes pourraient relier, sur un anneau urbain, une source photonique entremêlée, une mémoire quantique chaudement opérée et un processeur NISQ, avec le commutateur en nœud d’aiguillage. L’objectif immédiat a été de valider la stabilité sur 24 à 72 heures, les budgets de liaison par bande passante et l’empilage protocolaire jusqu’aux couches de contrôle. Les opérateurs ont eu intérêt à inventorier fibres disponibles, répartiteurs passifs et amplificateurs à contourner, tandis que les chercheurs ont instrumenté des métriques communes : taux d’intrication effectif, visibilité d’interférences, latence de commutation et gigue temporelle.

Pour accélérer sans s’illusionner, des jalons clairs ont été proposés. D’ici de 2026 à 2028, des profils d’interopérabilité ont dû être rédigés : cartographie des schémas de codage, gabarits de gigue, budgets de pertes, et clauses contractuelles anti‑dépendance dans les achats publics. Les fournisseurs ont été invités à exposer des interfaces de contrôle documentées, à publier des paquets logiciels de calibration et à aligner leurs télémétries. Les consortiums ont programmé des « semaines réseau » où chaque nœud devait échanger des états intriqués avec au moins deux technologies distinctes. Enfin, les financeurs ont priorisé des démonstrateurs orientés usages concrets : synchronisation de capteurs distribués, distribution avancée de clés et pré‑traitement hybride classique‑quantique. Ce cadre d’action a tracé un chemin pragmatique : transformer un prototype économe et précis en socle d’essais répétés, comparables et, surtout, reproductibles à l’échelle d’un opérateur.