Quand chaque centime dépensé par un agent IA doit prouver sa valeur, la tolérance au flou budgétaire s’évapore et le pilotage par la finance remplace les tableaux de bord purement techniques, installant une exigence de rentabilité mesurée au centime près et contrôlée comme un P&L. Cette bascule ne s’est pas jouée sur un détail de mise à l’échelle ; elle a surgi au moment où les dépenses de tokens, d’API et de supervision ont cessé d’être vues comme un pari d’innovation pour devenir une ligne de coût à défendre face au comité d’investissement.

Derrière ce déplacement, l’enjeu fut limpide : sortir de l’observabilité technique — latence, erreurs, disponibilité — pour imposer une observabilité économique et environnementale corrélée au revenu, à la marge et à l’empreinte carbone. La finance prit la main, exigeant le rattachement explicite de chaque dépense à un résultat métier vérifiable, avec des seuils de rentabilité posés a priori et non reconstruits a posteriori.

La promesse associée s’incarna dans Revenium AI Outcomes, présenté comme une tour de contrôle économique des agents IA. L’outil mit en correspondance les coûts élémentaires — tokens, appels API, temps de revue humaine — avec des événements valorisés par le métier : un prêt approuvé, une résolution de ticket notée hautement par le client, une commande expédiée sans erreur. La notion d’“Agent Debt” entra alors dans le vocabulaire : tout ce qui tourne sans créer de valeur mesurable doit être révélé, questionné, puis corrigé.

Le plan d’analyse qui suit déroule le panorama des tendances, les preuves d’adoption, les éclairages d’experts, le fonctionnement produit, la concurrence, les risques, les perspectives et des recommandations concrètes pour installer une observabilité économique et environnementale pilotée par le CFO.

1. Le Virage du Marché vers l’observabilité Économique

1.1 Données d’adoption et signaux de traction

Un faisceau de signaux convergea : l’augmentation rapide des dépenses IA, la pression FinOps pour contenir les factures cloud, et la montée du GreenOps pour relier l’empreinte carbone aux workloads d’agents. Les CFOs prirent la place centrale dans les arbitrages, demandant une mesure directe du coût par conversion, de la marge par flux et du retour sur dépense. Dans ce contexte, la levée de 13,5 M$ portée par Two Bear Capital et WestWave Capital servit d’indicateur de confiance, suggérant que le marché valorisait la discipline économique appliquée aux agents.

La maturité se traduisit par le passage des POC à des déploiements désormais régulés par des objectifs de ROI, avec des indicateurs recherchés tels que le rattachement dépenses-résultats, des alertes de dérive, et une empreinte carbone corrélée aux revenus tirés. Il ne s’agissait plus de prouver que l’agent “fonctionnait”, mais qu’il “gagnait sa vie” en contribuant à un P&L intelligible.

1.2 Applications concrètes et cas d’usage phares

Les cas d’usage phares clarifièrent le potentiel et les exigences méthodologiques. Dans l’automatisation de dossiers de prêts, un jalon marquant rapporta 1 000 dossiers traités pour 2 950 $, générant 390 000 $ de revenus et un ROI annoncé de 13 000 %. Le support client chercha l’équilibre entre coût par résolution et CSAT/NPS, tandis que la logistique suivit la marge par commande et le coût d’orchestration. Ces exemples cimentèrent l’idée qu’un agent doit être évalué à l’événement métier, pas à l’appel modèle.

Cependant, pour préserver la comparabilité, une clarification fine des granularités fut exigée : distinguer dossiers soumis, prêts effectivement approuvés et prêts décaissés ; séparer résolutions automatisées des escalades humaines ; préciser paniers moyens et taux de conversion. Sans ces garde-fous, les promesses de gain risquaient de se diluer dans des moyennes trompeuses.

2. Voix des Décideurs : Finance, Opérations et Capitaux

Les priorités des CFOs et des COOs s’alignèrent autour d’un triptyque : rattacher les coûts aux revenus, piloter la marge, intégrer la contrainte carbone et sécuriser la conformité. Les chartes de valorisation par événement — prêt approuvé, remboursement anticipé, résolution notée, abandon évité — devinrent des référentiels partagés, configurés comme des règles d’évaluation plutôt que des constats ex post.

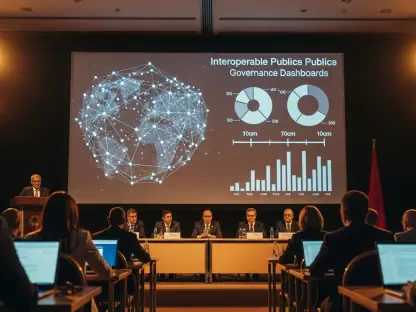

Avec cet alignement, la collaboration CFO-CTO se traduisit en tableaux de bord communs et en règles explicites de valorisation des événements métier. Du côté des investisseurs, l’observabilité économique émergea comme une catégorie naissante : le momentum attendu portait sur l’industrialisation, la normalisation des métriques et l’aptitude à tenir la rigueur d’audit face à des environnements réglementés.

3. Revenium AI Outcomes : du Suivi Technique au Résultat Économique

3.1 Double métrique : performance technique vs valeur créée

Le cœur fonctionnel reposa sur une séparation stricte : l’agent qui fonctionne n’est pas l’agent qui crée de la valeur. Revenium proposa un modèle où chaque événement métier reçoit une valeur : un prêt approuvé vaut x $, un transfert à un humain coûte y $, un échange d’assistance peut valoir 0 $ immédiat mais influencer la LTV. Ce découplage réduisit l’“Agent Debt” en rendant visibles les intégrations sans rendement.

Cette double lecture installa une grammaire simple pour les directions : des KPIs systèmes servent la fiabilité, mais seuls les résultats valorisés décident des réinvestissements. Ainsi, l’outil poussa à classer les scénarios d’agents non par complexité technique, mais par contribution nette au revenu et à la satisfaction.

3.2 Comptabilité granulaire et pilotage CFO

La plateforme traça chaque ligne de coût : tokens consommés, appels API, temps de supervision humaine, cycles de ré-essai. Ces entrées furent agrégées vers des KPIs financiers comme le coût par conversion, le CAC marginal, la marge par flux et le ratio LTV/CAC. Les CFOs purent arbitrer en temps réel : accélérer un scénario rentable, freiner une expérience coûteuse, suspendre une intégration en dérive.

Des tableaux de bord relièrent investissement total et gains observés, avec des alertes proactives sur les dépassements budgétaires et les seuils de rentabilité. L’apport ne fut pas seulement la visibilité, mais la capacité d’agir plus tôt, avant que l’“Agent Debt” ne s’accumule en coûts irrécouvrables.

3.3 FinOps et GreenOps intégrés

Revenium raccrocha les dépenses à une empreinte carbone mesurée par workload et par agent. Cette jonction permit d’arbitrer coût, performance et carbone au niveau des scénarios métier, introduisant une dimension RSE dans les décisions de priorisation. Les directions purent ainsi piloter non seulement la marge, mais aussi l’intensité carbone par conversion.

Cette capacité facilita les exigences de conformité extra-financière, offrant une traçabilité unifiée des coûts et des émissions, lisible lors d’audits et compréhensible par les comités des risques. L’alignement FinOps/GreenOps cessa d’être un slogan pour devenir un système de décision quotidien.

3.4 Transparence anti-boîte noire

L’outil effectua un glissement des KPIs techniques vers des indicateurs business directs : revenu, satisfaction, marge nette. Les équipes d’audit et les CFOs obtinrent une traçabilité explicable, reliant chaque coût à un résultat. Ce langage commun facilita les arbitrages budgétaires, mit fin aux débats stériles sur la seule latence, et réorienta la priorité vers la rentabilité prouvée.

En rendant explicites les hypothèses de valorisation, Revenium permit une révision gouvernée : ajuster la valeur d’un événement, tester un scénario alternatif, documenter l’impact sur la marge. La boîte noire des agents se transforma en registre économique inspectable.

4. Positionnement Concurrentiel et Stratégie de Mise sur le Marché

4.1 Face à Datadog : technique vs économique

La comparaison avec Datadog souligna une différence de nature : observabilité technique d’un côté, observabilité économique de l’autre. Un service peut afficher 95 % de tickets “clôturés” tout en détruisant de la valeur si le CSAT chute ou si le coût par interaction explose. Revenium revendiqua l’avantage de parler la langue du revenu et de la marge, adressant prioritairement la direction financière.

Cet angle permit de déplacer la discussion : non pas “le service est-il stable ? ”, mais “le service crée-t-il de la marge durable ? ”. Le changement culturel fut net, et l’avantage concurrentiel se joua sur la capacité à prouver le profit, pas seulement la performance.

4.2 Face aux hyperscalers (ex. : AWS)

Les hyperscalers apportèrent puissance, intégration et écosystèmes étendus, mais relier finement coût technique et résultat métier se révéla plus ardu à l’échelle de plateformes généralistes. L’hypothèse de travail plaça Revenium comme une couche standard d’“economic control” au-dessus des stacks IA, interopérable et focalisée sur la valeur.

Cette posture de neutralité vis-à-vis des clouds offrit un bénéfice immédiat aux entreprises multi-stacks : une lecture économique cohérente des agents, quel que soit l’hébergeur, avec des règles de valorisation constantes.

4.3 Traction commerciale et adoption

Les premières cibles furent les banques, les éditeurs SaaS et des entreprises multi‑lignes. Même si les logos restèrent confidentiels, les signaux d’intérêt se stabilisèrent : cycles de POC raccourcis, comités d’investissement sollicitant des démonstrations orientées marge, et adhésion des équipes RSE pour le couplage coût-carbone.

Un modèle freemium, associé à un POC “en quelques minutes”, servit d’accélérateur. La démonstration rapide de valeur montra des économies tangibles, mais surtout une gouvernance des règles métier que la finance put auditer.

4.4 Feuille de route et livrables

L’historique suivit une progression lisible : Tool Registry pour cartographier les coûts, puis AI Outcomes pour relier dépenses et résultats. Les prochaines étapes mirent l’accent sur l’affichage des marges réelles, les alertes préventives et la prévention des dérapages avant qu’ils n’affectent le P&L.

L’interfaçage reposa sur des intégrations systèmes existants et une API de standardisation des métriques, de sorte que la valeur perçue ne dépendit pas d’un remplacement d’outillage, mais d’une couche d’orchestration économique.

5. Mesure d’impact : preuves et extensions sectorielles

5.1 Cas fintech/prêts : résultats et nuances

Le démonstrateur fintech montra un saut d’échelle : de 200 heures et 7 000 $ à 1 000 dossiers en trois minutes pour 2 950 $, avec +95 % d’approbations et une dépense totale divisée par deux. Le coût par conversion fut affiché à 3,78 $, soutien chiffré d’un ROI de 13 000 %. Cette traction fit office de preuve de concept pour un pilotage au résultat.

Néanmoins, la robustesse méthodologique invita à préciser l’écart entre “780 prêts en 3 minutes” et “1 000 dossiers”, à poser les hypothèses de taux d’approbation, de défaut et de qualité des données, et à calculer la marge après risque. Cette discipline assura que l’enthousiasme marketing ne dépasse pas la réalité économique.

5.2 Support client et logistique : métriques orientées valeur

Dans le support, l’analyse rapprocha CSAT/NPS, réachat, churn et LTV du coût par résolution, afin de distinguer la réduction de tickets du gain net de valeur. Un ticket clôturé sans satisfaction ne fut plus compté comme succès ; seule la contribution à la relation client et au revenu prit le dessus.

En logistique, le temps de cycle, les erreurs évitées et la marge par commande furent suivis face au coût d’orchestration des agents. Là encore, la mesure par événement orienta les arbitrages : augmenter une capacité qui améliore la marge unitaire, geler une automatisation qui n’atteint pas le seuil de rentabilité.

5.3 Alignement opérationnel : des règles de valorisation aux décisions

Les équipes métiers définissent des seuils de rentabilité et la valeur par événement, transformant la gouvernance en un mécanisme vivant. Ces règles alimentèrent des boucles d’amélioration : tests A/B d’agents évalués non seulement sur la latence, mais sur la marge, le CSAT et l’empreinte carbone par interaction.

Ce cadre donna un langage commun aux opérations et à la finance. Les décisions de priorisation se prirent sur des cartes de valeur, non sur des intuitions, réduisant le délai entre constat et action.

6. Limites, Risques et Conditions de Succès

6.1 Durabilité des ROIs extrêmes

Un ROI de 13 000 % marqua les esprits, mais resta contextuel. La durabilité exigea des répliques multi‑secteurs, une observation dans la durée, et une sensibilité testée aux hypothèses de données, de fraude, de conformité, de coûts d’escalade et de défaut. Sans cette prudence, le risque de réversion des gains demeura élevé.

L’approche prudente consistit à verrouiller la fiabilité des flux, à intégrer des coûts complets et à simuler des chocs. Une rentabilité qui survit à ces stress-tests inspira davantage confiance aux comités d’audit.

6.2 Méthodologie de mesure et proxies de valeur

La qualité des proxys — CSAT, NPS, réachat, churn, LTV — conditionna la justesse des décisions. Un sur‑ajustement aux métriques faciles à bouger put masquer des effets indésirables sur la fidélité ou la marge. D’où l’importance d’une auditabilité ferme et d’une gouvernance claire des règles de valorisation.

Des journaux d’hypothèses versionnés, des contrôles d’accès et des revues périodiques consolidèrent la crédibilité du dispositif. L’enjeu fut moins l’élégance des dashboards que la fiabilité des liens causaux.

6.3 De l’effet annonce à l’exécution

Le passage à l’échelle demanda une industrialisation méthodique : intégrations complexes, résilience des pipelines de coûts et d’événements, compétence accrue des équipes finance/ops. Sans accompagnement au changement, la promesse resta lettre morte.

Les organisations qui réussirent firent de l’observabilité économique une routine : cadences de revue, budgets dynamiques, et sponsors exécutifs capables d’arbitrer quand la donnée dissonait avec l’intuition.

7. Prospective : quelle Trajectoire pour l’observabilité Économique ?

7.1 Scénarios stratégiques

Deux trajectoires se dégagèrent. Premièrement, une domination rapide du segment FinOps IA portée par un standard API d’“economic control” adopté par les stacks principales. Deuxièmement, une intégration par rachat dans une suite d’observabilité établie, infusant la logique de profit au cœur des outils techniques. L’arbitrage opposa indépendance et impact à grande échelle.

Dans les deux cas, la valeur cardinale demeura la même : prouver, ligne à ligne, que l’agent crée plus de valeur qu’il n’en consomme.

7.2 Normalisation des métriques et gouvernance

La normalisation avança vers un vocabulaire commun : ROI, coût par conversion, marge, CSAT/NPS, empreinte carbone. Les CFOs prirent un rôle accru dans la définition de SLAs et de SLGs business, déplaçant l’attention des seuils techniques vers des cibles économiques négociées.

Cette codification réduisit la variabilité inter‑équipes et facilita les comparaisons sectorielles, accélérant l’apprentissage collectif.

7.3 Implications sectorielles et sociétales

Les agents commencèrent à être traités comme des “employés” avec un P&L attribué, ancrant responsabilité et transparence. La convergence FinOps/GreenOps rendit l’optimisation coût-carbone-performance indissociable, influençant la conception produit et les politiques d’achat technologique.

Ce déplacement façonna des cultures d’entreprise où la preuve de valeur remplaça l’effet vitrine, renforçant la confiance des marchés et des régulateurs.

8. Conclusion et Appel à l’action

8.1 Synthèse des enseignements

La période observée avait montré que la valeur de l’IA se mesurait au résultat financier et à la satisfaction client, non à la latence. Revenium avait fourni les instruments pour passer du suivi technique au contrôle économique, révélant l’“Agent Debt” et alignant CFO et CTO autour de métriques partagées. La discipline instaurée avait donné aux entreprises une capacité d’arbitrage fondée sur des événements valorisés, plutôt que sur des agrégats systèmes.

8.2 Prochaines étapes pour les décideurs

La suite logique avait consisté à lancer un POC court avec des règles de valorisation claires par événement, à installer des tableaux de bord partagés avec alertes budgétaires et suivi carbone, puis à généraliser les boucles d’amélioration pilotées par la marge et le CSAT. En rendant chaque décision traçable et chaque coût explicable, l’observabilité économique avait préparé les organisations à transformer des agents prometteurs en créateurs de valeur durable, tout en ancrant une gouvernance prête pour l’audit et la régulation à venir.